Washington University of St. Louis

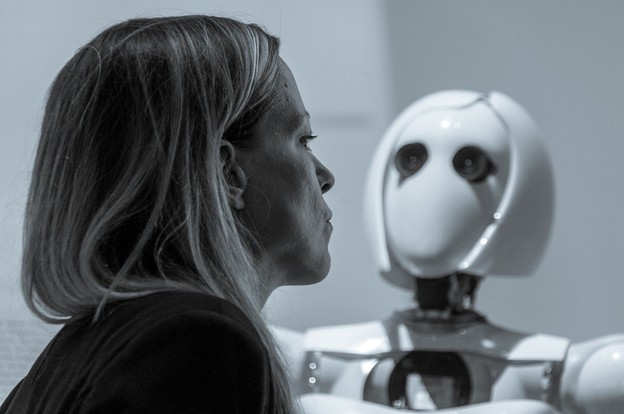

Treniranje AI modela mijenja ponašanje ljudi

Istraživači otkrivaju kako interakcije s AI modelima utječu na ljude koji ih obučavaju.

Posljednjih godina ljudi se sve više oslanjaju na umjetnu inteligenciju koja im pomaže u donošenju odluka. Ovi modeli ne samo da nam pomažu, već i uče iz našeg ponašanja. Stoga je važno razumjeti kako naše interakcije s AI modelima utječu na njih.

Trenutna praksa pretpostavlja da je ljudsko ponašanje koje se koristi za treniranje AI modela nepristrano. Međutim, rad znanstvenika Sveučilišta u Washingtonu u St. Louisu, dovodi u pitanje ovu pretpostavku.

Oni pokazuju da ljudi mijenjaju svoje ponašanje kada su svjesni da se koristi za treniranje umjetne inteligencije. Štoviše, ovo ponašanje traje danima nakon završetka treninga.

Ovi nalazi ističu problem s razvojem umjetne inteligencije. Pretpostavke o nepristranim podacima o obuci mogu dovesti do nenamjerno pristranih modela. Ova umjetna inteligencija može ojačati te navike, što rezultira odstupanjem i ljudi i umjetne inteligencije od optimalnog ponašanja.

Umjetna inteligencija je sada sastavni dio svakodnevnog donošenja odluka, pomažući nam u rutinskim i zahtjevnim izborima. Ovi modeli često uče iz ljudskog ponašanja, pod pretpostavkom da su podaci o obuci nepristrani. Međutim, znanstvenici izvješćuju o pet studija koje pokazuju da ljudi mijenjaju svoje ponašanje kako bi usadili željene rutine u umjetnu inteligenciju, što ukazuje da je ova pretpostavka nevaljana.

Kako bi pokazali ovu promjenu u ponašanju, regrutirali su sudionike da igraju "igru ultimatuma", gdje su trebali odlučiti hoće li prihvatiti prijedloge o novčanim podjelama koje su dali drugi ljudski sudionici ili AI.

Neki su sudionici obaviješteni da će se njihovi izbori koristiti za obuku umjetne inteligencije, dok drugi nisu primili tu informaciju. Kroz pet eksperimenata otkrili su da su ljudi modificirali svoje ponašanje kako bi obučili umjetnu inteligenciju da daje poštene prijedloge, bez obzira na to mogu li imati izravnu korist od obuke umjetne inteligencije.

Nakon što su jednom dovršili ovaj zadatak, sudionici su pozvani da ga ponovno izvrše, ali im je rečeno da se njihovi odgovori neće koristiti za obuku umjetne inteligencije. Ljudi koji su prethodno trenirali AI ustrajali su u ovoj promjeni ponašanja, što ukazuje da je nova rutina ponašanja postala uobičajena. Ovaj rad pokazuje da korištenje ljudskog ponašanja kao podataka za obuku ima više posljedica nego što se dosad mislilo budući da može potaknuti umjetnu inteligenciju da navede ljude na stvaranje navika koje odstupaju od načina na koji bi inače postupali. Stoga ovaj rad naglašava problem za algoritme umjetne inteligencije koji imaju za cilj naučiti nepristrane prikaze ljudskih preferencija.

Studiju objavljenu u časopisu PNAS možete pronaći na ovoj poveznici.

Učitavam komentare ...